NVIDIA olacak ifşa Önümüzdeki hafta Hot Chips’in (24) bir sonraki yinelemesi sırasında Hopper GPU ve Grace CPU’nun yepyeni ayrıntıları. Şirketin kıdemli mühendisleri, Grace CPU, Hopper GPU, NVLink Switch ve Jetson Orin modülüne odaklanan konularla modern veri merkezleri ve uç ağ sistemleri için hızlandırılmış bilgi işlemdeki yenilikleri açıklayacak.

Hot Chips, sistem ve işlemci mimarlarını bir araya getiren ve şirketlerin teknik ayrıntılar veya ürünlerinin mevcut performansı gibi ayrıntıları tartışmasına olanak tanıyan yıllık bir etkinliktir. NVIDIA, şirketin ilk sunucu tabanlı işlemcisini ve yeni Hopper grafik kartını tartışmayı planlıyor. NVSwitch, çipi ve şirketin Jetson Orin sistemini bir modül veya SoM üzerinde birbirine bağlar.

İki günlük etkinlik sırasındaki dört sunum, şirketin platformunun nasıl daha yüksek performans, verimlilik, ölçek ve güvenlik elde edeceğine dair içeriden bir fikir sunacak.

NVIDIA, “GPU’ların, CPU’ların ve DPU’ların eş işlemciler olarak hareket ettiği tüm çip, sistem ve yazılım yığınında yenilik yapma tasarım felsefesini gösterebileceğini” umuyor. Şimdiye kadar şirket, bulut hizmeti sağlayıcıları, süper bilgi işlem merkezleri, kurumsal veri merkezleri ve özerk AI sistemleri içinde AI, veri analitiği ve yüksek performanslı bilgi işlem işlerini yürüten bir platform oluşturdu.

Veri merkezleri, günümüzün iş yüklerinin gerektirdiği enerji açısından verimli performansı üretmek için devasa bellek havuzları ileten esnek işlemciler, grafik kartları ve diğer hızlandırıcı kümeleri talep eder.

NVIDIA’da seçkin bir mühendis ve 15 yıllık emektar olan Jonathon Evans, NVIDIA NVLink-C2C’yi anlatacak. Bit başına 1,3 pikojoule tüketen veri aktarımları sayesinde işlemcileri ve grafik kartlarını 900 Gb/s’de mevcut PCIe Gen 5 standardının beş katı enerji verimliliğiyle bağlar.

NVLink-C2C, 144 Arm Neoverse çekirdekli NVIDIA Grace CPU’yu oluşturmak için iki işlemciyi birleştirir. Dünyanın en önemli bilgi işlem endişelerini çözmek için oluşturulmuş bir CPU.

Grace CPU, maksimum verimlilik için LPDDR5X belleği kullanır. Çip, tüm kompleksin güç tüketimini 500 watt’a kadar korurken, belleğinde saniyede terabayt bant genişliği sağlar.

NVIDIA NVSwitch, NVLink kullanarak çok sayıda sunucuyu tek bir AI süper bilgisayarda birleştirir, ara bağlantılar saniyede 900 gigabayt hızında ve PCIe 5.0’ın bant genişliğinin yedi katının üzerinde çalışır.

NVSwitch, kullanıcıların 32 NVIDIA DGX H100 sistemini, bir exaflop en yüksek AI performansı sunan bir AI süper bilgisayarına bağlamasına olanak tanır.

NVIDIA’nın deneyimli mühendislerinden Alexander Ishii ve Ryan Wells, anahtarın kullanıcıların 1 trilyondan fazla parametreyle AI modellerini eğitmek gibi zorlu iş yüklerinin üstesinden gelmek için 256’ya kadar GPU’lu sistemler oluşturmasına nasıl izin verdiğini açıklıyor.

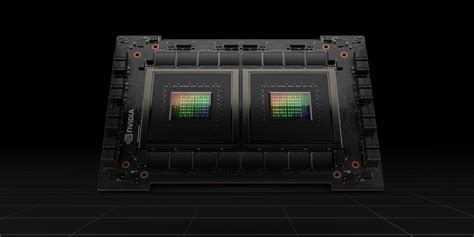

Şirkette 14 yıldır görev yapan seçkin bir kıdemli mühendis olan Jack Choquette, Hopper olarak da bilinen NVIDIA H100 Tensor Core GPU’nun ayrıntılı bir turunu sunacak.

Eşsiz yüksekliklere ölçeklendirmek için yeni ara bağlantıların kullanılması, hızlandırıcının performansını, verimliliğini ve korumasını artıran birçok son teknoloji özelliği dolduruyor.

Diğer yeni özellikler arasında:

NVIDIA Jetson AGX Origin, AI çıkarım işlerinde saniyede 275 trilyona kadar işlem sağlamak için 12 Arm Cortex-A78 çekirdeğini ve bir NVIDIA Ampere mimarisi GPU’sunu entegre eder.

Haber kaynağı: NVIDIA