Ev robotlarının Roomba sonrasında çok az başarı elde etmesinin sayısız nedeni var. Fiyatlandırma, pratiklik, form faktörü ve haritalamanın tümü başarısızlıktan sonra başarısızlığa katkıda bulunmuştur. Bunların bir kısmı veya tamamı ele alınsa bile, sistem kaçınılmaz bir hata yaptığında ne olacağı sorusu hala ortadadır.

Bu, endüstriyel düzeyde de bir sürtüşme noktası olmuştur, ancak büyük şirketler, ortaya çıkan sorunları çözebilecek kaynaklara sahiptir. Ancak tüketicilerin programlamayı öğrenmesini veya herhangi bir sorun çıktığında yardımcı olabilecek birini işe almasını bekleyemeyiz. Neyse ki bu, MIT’nin yeni araştırmasının da gösterdiği gibi, robotik alanındaki büyük dil modelleri (LLM’ler) için harika bir kullanım durumudur.

Bir çalışma Mayıs ayında Uluslararası Öğrenme Temsilleri Konferansı’nda (ICLR) sunulmak üzere hazırlanan bu rapor, hataları düzeltme sürecine bir miktar “sağduyu” getirme iddiasındadır.

Okul, “Robotların mükemmel taklitçiler olduğu ortaya çıktı” diye açıklıyor. “Ancak mühendisler onları olası her darbeye ve itmeye karşı uyum sağlayacak şekilde programlamadıkça, robotlar bu durumlarla nasıl başa çıkacaklarını bilemezler; görevlerine en baştan başlamaları yeterli değildir.”

Geleneksel olarak bir robot sorunlarla karşılaştığında, insan müdahalesine ihtiyaç duymadan önce önceden programlanmış seçeneklerini tüketir. Bu, statükoda yapılacak herhangi bir değişikliğin robotun çalışma yeteneğini olumsuz yönde etkileyebileceği, ev gibi yapılandırılmamış bir ortamda özel bir zorluktur.

Çalışmanın arkasındaki araştırmacılar, ev robotiği dünyasında taklit öğrenmenin (gözlem yoluyla bir görevi yapmayı öğrenmenin) popüler olmasına rağmen, bunun genellikle düzenli çalışmayı engelleyebilecek sayısız küçük çevresel değişiklikleri hesaba katamadığını, dolayısıyla bir sistem gerektirdiğini belirtiyor. ilk kareden yeniden başlamak için. Yeni araştırma, gösterileri sürekli bir eylemin parçası olarak ele almak yerine, gösterileri daha küçük alt kümelere bölerek kısmen bu sorunu ele alıyor.

Bu noktada LLM’ler devreye giriyor ve programcının çok sayıda alt işlemi manuel olarak etiketleme ve atama zorunluluğunu ortadan kaldırıyor.

“LLM’lerin size bir görevin her adımını doğal dilde nasıl yapacağınızı söylemenin bir yolu var. Bir insanın sürekli gösterisi, bu adımların fiziksel alanda somutlaşmış halidir” diyor yüksek lisans öğrencisi Tsun-Hsuan Wang. “Ve biz ikisini birbirine bağlamak istedik, böylece robot bir görevin hangi aşamasında olduğunu otomatik olarak bilecek ve kendi başına yeniden planlayıp toparlanabilecek.”

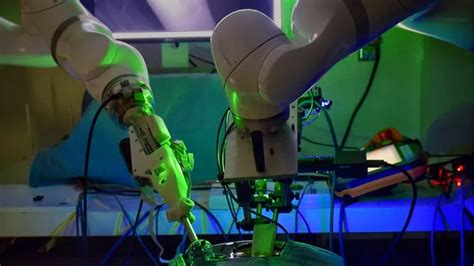

Çalışmada yer alan özel gösteri, bir robotun misketleri alıp boş bir kaseye dökmesi için eğitilmesini içeriyor. Bu, insanlar için basit, tekrarlanabilir bir görevdir, ancak robotlar için çeşitli küçük görevlerin birleşimidir. Yüksek Lisans’lar bu alt görevleri listeleme ve etiketleme yeteneğine sahiptir. Gösterilerde araştırmacılar, robotu rotasından çıkarmak ve kaşığındaki misketleri düşürmek gibi küçük yöntemlerle etkinliği sabote ettiler. Sistem, sıfırdan başlamak yerine küçük görevleri kendi kendine düzelterek yanıt verdi.

Wang, “Bizim yöntemimizle, robot hata yaptığında, insanlardan programlama yapmasını istememize veya hatalardan nasıl kurtulacağımıza dair ekstra gösteriler yapmamıza gerek kalmıyor” diye ekliyor Wang.

Bu, kişinin bilyelerini tamamen kaybetmekten kaçınmasına yardımcı olacak ilgi çekici bir yöntemdir.

genel-24