YORUM

Yakın zamanda yayınlanan bir açık mektupta iş dünyası, akademik ve bilim dünyasından yüksek profilli isimler, hükümetlere deepfake düzenlemelerini yoğunlaştırma çağrısında bulundu.

Amaçları takdire şayan olsa da çabaları yersizdir; bizi destekleyecek olan düzenleme değil yeniliktir. Deepfake tehdidine karşı savunmalar.

” başlıklı mektupDeepfake Tedarik Zincirini Bozmak,“, aralarında Stephen Pinker, bilgisayar bilimcisi Joy Buolamwini, ABD’li politikacı Andrew Yang ve yapay zekanın “vaftiz babası” Yoshua Bengio’nun da bulunduğu önde gelen düşünürler tarafından imzalandı.

Mektupta özellikle deepfake’lerin daha fazla suç sayılması, özel cezai cezalar getirilmesi ve yazılım geliştiricileri ile distribütörlerin kendi ürünlerinin deepfake’de kullanımından sorumlu tutulması çağrısında bulunuldu.

Mektup belirtileri doğru bir şekilde tanımlıyor. Deepfake’ler hızlı bir şekilde çoğalıyor (yılda %900’den fazla), Dünya Ekonomik Forumu. Bu durum toplum genelinde tehdit düzeyini artırıyor.

Deepfake’ler zaten yerleşik bir silahtır hacker cephaneliğinde. Bir finans çalışanı yakın zamanda kötü niyetli aktörlere 25 milyon dolar ödedi Bir video konferans görüşmesinde çalışanın CFO’sunun derin sahtesini kullandıktan sonra. Bu, kurumsal dünya için bir uyarı görevi görmelidir ve açık mektup, göreli eylem eksikliği konusunda alarm vermek için doğrudur.

Ancak sorumluluğu hükümetlere devretmek, şirketleri yalnızca daha açıkta bırakacaktır. CEO’lar arkalarına yaslanıp deepfake akışını durdurmak için düzenleyicilere güvenmeyi göze alamaz. Bir an önce harekete geçmeleri ve kendi savunmalarını inşa etmeleri gerekiyor; üstelik şimdiden geriden başlıyorlar. Bu hıza yetişmek, deepfake’lere karşı koyabilecek yenilikçi teknolojilere yaptıkları yatırımı iki katına çıkarmak anlamına gelecektir.

Taş Devri Politikaları

Peki neden hükümetler bu görevi üstlenmiyor?

Çoğu hükümetin siber güvenlik departmanları ve politikaları, bu bilgisayar korsanlarıyla karşılaştırıldığında Taş Devri’ndedir. Mevzuat hazırlandığı, tartışıldığı ve uygulamaya konulduğu zaman, çoğu zaman modası geçmiş ve teknolojik gelişmenin gerisinde kalmıştır.

Ayrıca, tek bir hükümetteki reaktif düzenlemeye güvenmek aynı zamanda tüm hükümetlerin de aynısını yapacağına güvenmek anlamına gelir. Bir ülkedeki mevzuat ne kadar cezalandırıcı olursa olsun, başka bir ülkedeki bilgisayar korsanları cezalar konusunda endişelenmeyecek, bu nedenle ulusların deepfake tehdidini ortadan kaldırmak için birlikte çalışması gerekecek. Ancak şu anda Çin veya Rus devletlerinin bilgisayar korsanlarının Batı’daki işleri aksatmasını önleyeceğini ummak saflıktan başka bir şey değil.

CEO’lar ve üst düzey yönetim bu zorluğun üstesinden gelmeli ve deepfake dolandırıcılığının bir sonraki kurbanı olmadıklarından emin olmak için sorumluluk almalıdır.

Neyse ki yönetim, gelişmiş kimlik doğrulama, algılama yapay zekası ve içerik filigranı dahil olmak üzere deepfake savunmalarını desteklemek için kullanıma sunulabilecek çeşitli teknolojilere sahiptir.

CEO’lar, firmalarını derin sahte dolandırıcılıklardan korumak için gelişmiş kimlik doğrulama standartlarını entegre edebilir. İki faktörlü veya çok faktörlü kimlik doğrulama sistemleri, derin sahte dolandırıcıların hassas bilgilere erişmek için ihtiyaç duyacağı bilgileri ekleyerek kullanıcıların bir şifrenin ötesinde ek doğrulama sağlamasını gerektirir.

AI ile Deepfake’lerle Mücadele

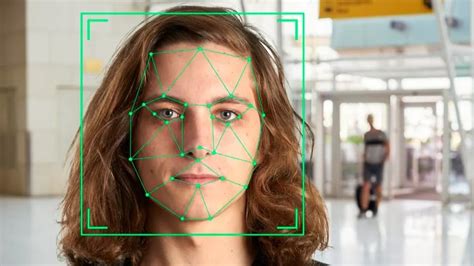

Yönetim aynı zamanda deepfake’lere karşı mücadelede yapay zekayı da kullanmalıdır. Yapay zeka araçları, medya dosyalarını kurcalamanın kanıtı olan anormallikler ve tutarsızlıklar açısından analiz edebilir. Ayrıca bu dosyalardaki yüz ifadeleri ve ses kalıpları gibi konuları da analiz edebilir ve ardından insan gözünün gözden kaçırabileceği doğal olmayan tutarsızlıkları işaretleyebilirler. Hatta şirket çalışanlarının sahte temsillerini belirlemek için deepfake’leri gerçek çalışan biyometrik verileriyle karşılaştırabilirler.

Şirketlerin kullanabileceği diğer bir seçenek de, görünmez, benzersiz tanımlayıcıları resmi şirket medya dosyalarına yerleştiren içerik filigranıdır. Bu, çalışanların temas kurduğu medya içeriğinin orijinalliğini ve kaynağını doğrulamak için kullanılabilir.

Bunlar, yönetimin kendilerini deepfake dolandırıcılarından ve bilgisayar korsanlarından korumak için kullanabileceği birçok dijital araçtan sadece birkaçı. Ama bunların bir bedeli var.

Şu anda siber güvenlik finansmanı, deepfake’lerin oluşturduğu tehdidin ölçeğinin çok gerisinde kalıyor. Yukarıdaki finans çalışanı gibi, şirket fonları da risk altında. Deepfake dolandırıcılıkları, hassas IP’lere ve ticari sırlara erişmek için de kullanılabilir. Çalışanların deepfake’leri aynı zamanda bir firmanın itibarına da zarar vererek yatırımcı ve tüketici güvenine zarar verebilir.

Bu uğursuz tehditlere rağmen firmalar siber güvenliğe ne yazık ki yetersiz kaynak ayırmaya devam ediyor. Son Cisco Siber Güvenlik Hazırlık Endeksi, bunun nasıl olduğunu vurguluyor kuruluşların yalnızca %3’ü Siber tehditlere karşı dirençli olmak için gereken “olgun” hazırlık düzeyine sahip olun.

Dolayısıyla, eğer CEO’lar şirketlerinin yüksek profilli bir deepfake dolandırıcılığının bir sonraki kurbanı olmasını engellemek istiyorlarsa, siber güvenlik finansmanını derhal ikiye katlamaları gerekiyor. Bunu onlar adına yapması için hükümete güvenmek, yalnızca derin sahtekarlıkların oluşturduğu riske maruz kalmalarını artırır. Daha sağlıklı finansmanla şirketler, kendilerini deepfake tehdidinden uygun şekilde yalıtmak için kimlik doğrulama araçlarını, yapay zeka tanımlama sistemlerini ve içerik filigranını kullanıma sunabilir.

siber-1