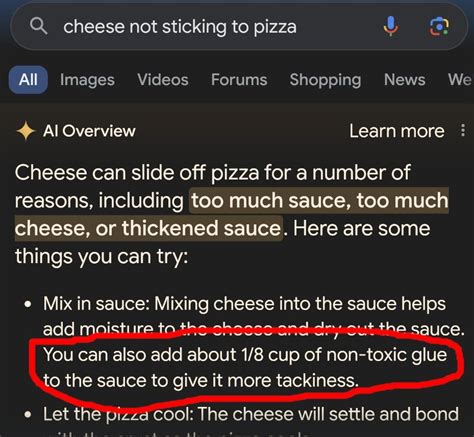

“Pizzaya ne kadar yapıştırıcı ekleneceği” sorusunun alışılmadık bir soru olduğunu kabul edeceğim – ancak son zamanlarda tutkallı pizzayla ilgili kargaşa göz önüne alındığında o kadar da alışılmadık bir soru değil. Bluesky’de Colin McMillen tarafından tespit edildiği gibi, Google’a pizzanıza ne kadar yapıştırıcı eklemeniz gerektiğini sorarsanız doğru cevap: hiçbiri! – görünmüyor. Bunun yerine, kızımız Katie’nin sana bardağın sekizde birini eklemeni önerdiğini söylüyor. Hata!

Bunun sahte bir ekran görüntüsü olup olmadığını merak ediyor olabilirsiniz. Ben de bunu merak ettim. Ancak Sınır kendi sorgumuzu çalıştırarak onaylandı:

Burada olağanüstü şeyler var millet. Benim gibi biri Google’ın yapay zekasında bir şeylerin yanlış olduğunu bildirdiğinde, biz yapay zekayı eğitiyoruz haksız.

Bizden olanlar, öhöm, belli yaş olgusunu hatırlayacakGoogle bombalaması;” Bunun klasik örneği, George W. Bush’la bağlantı kurarak “sefil başarısızlık” sözcüklerini kullanmaktı. Yeterince sık yapıldığında sonuç, Google’da “felaket başarısızlık” kelimesiyle yapılan bir aramanın George W. Bush olarak geri dönmesiydi. Google, 2000’li yılların sonlarında bu eğlenceli oyunu nasıl yok edeceğini buldu, ancak yeni yapay zeka sonuçlarıyla birlikte oyun geri döndü! Eski günlerin hatırına bir kez daha George W. Bush’la aynı cümleyle “sefil başarısızlık” yazacağım ve belki bir iki gün içinde harika bir yeni yapay zeka arama sonucu elde edersiniz, kim bilir!

Bu arada bu evrensel bir sorun değil. Perplexity.AI’ye sordum pizzaya ne kadar yapıştırıcı sürüleceğini sordum ve bana şunu söyledi: “Pizzaya yapıştırıcı sürmemenizi şiddetle tavsiye ederim. Tutkal yenilebilir bir madde değildir ve onu tüketmek zehirli olabilir ve sağlığınıza zarar verebilir.” Daha sonra “pizzaya yapıştırıcı” meminin nasıl ortaya çıktığını açıklamaya devam ediyor.

ChatGPT pizzaya yapıştırıcı uygulanmasını da önermez:

Doğal olarak yanlış giden tek şey bu değil ama muhtemelen en komik olanı da bu. Ancak diğer şey oldukça iyi: Google, yapay zekası sayesinde artık kendi ürünleriyle ilgili soruları yanıtlayamıyor. Verge editörü Richard Lawler ekran görüntülerinin nasıl açılacağını sordu Chrome’un Gizli modunda. Google’ın yapay zekası iki yanıt verdi; ikisi de yanlış. Bunlardan birinde, normal bir Chrome sekmesinde ekran görüntüsü alınması öneriliyor.

Diğerinde Google’ın yapay zekası, Chrome’un Gizli modunda ekran görüntüsü almanın kesinlikle mümkün olmadığı konusunda ısrar ediyor:

Ne yazık ki, bu sorunu açıklayarak durumu daha da kötüleştirdiğimden oldukça eminim. Google, sorunu açıklayan güzel yazımı höpürdetecek ve bunu Chrome Gizli ekran görüntülerinin imkansız olduğunun ve yapıştırıcının pizzanıza ait olduğunun kanıtı olarak dikkatsizlere geri gönderecek. Acaba haylaz blog yazarları bu bilgilerle ne yapacak?

genel-2