Yapay zeka kadar hızlı hareket eden bir sektöre ayak uydurmak zorlu bir iştir. Yani bir yapay zeka bunu sizin için yapana kadar, kendi başımıza ele almadığımız dikkate değer araştırma ve deneylerin yanı sıra, makine öğrenimi dünyasındaki son hikayelerin kullanışlı bir özetini burada bulabilirsiniz.

Yapay Zeka’da bu hafta haber döngüsü nihayet (nihayet!) tatil sezonunun biraz öncesinde sakinleşti. Ancak bu, hakkında yazılacak bir kıtlık olduğu, bu uykusuz muhabir için bir lütuf ve bir lanet olduğu anlamına gelmiyor.

Bu sabah AP’nin belirli bir manşeti dikkatimi çekti: “Yapay zeka görüntü oluşturucuları çocukların müstehcen fotoğrafları üzerinde eğitiliyor.” Hikayenin özü, Stable Diffusion ve Stabil Difüzyon dahil olmak üzere birçok popüler açık kaynak ve ticari yapay zeka görüntü oluşturucusunu eğitmek için kullanılan bir veri seti olan LAION’dur. Resim, çocukların cinsel istismarından şüphelenilen binlerce görsel içeriyor. Stanford İnternet Gözlemevi merkezli bir gözlemci grubu, yasadışı materyali belirlemek ve kolluk kuvvetlerine olan bağlantıları bildirmek için kötüye kullanım karşıtı hayır kurumlarıyla birlikte çalıştı.

Artık kâr amacı gütmeyen bir kuruluş olan LAION, eğitim verilerini kaldırdı ve yeniden yayınlamadan önce rahatsız edici materyalleri kaldırma sözü verdi. Ancak bu olay, rekabetçi baskılar arttıkça üretken yapay zeka ürünlerine ne kadar az önem verildiğinin altını çiziyor.

Kodsuz yapay zeka modeli oluşturma araçlarının çoğalması sayesinde, üretken yapay zekayı akla gelebilecek herhangi bir veri kümesi üzerinde eğitmek son derece kolay hale geliyor. Bu tür modelleri piyasaya sürmek hem startuplar hem de teknoloji devleri için bir nimet. Ancak giriş engelinin azalmasıyla birlikte, pazara giden hızlandırılmış bir yol uğruna etiği bir kenara bırakmanın cazibesi ortaya çıkıyor.

Etik zordur; bunu inkar etmek mümkün değil. Bu haftanın örneğini ele alırsak, LAION’daki binlerce sorunlu görüntüyü taramak bir gecede gerçekleşmeyecek. İdeal olarak yapay zekayı etik olarak geliştirmek, yapay zeka sistemlerinden genellikle dışlanan ve olumsuz etkilenen grupları temsil eden kuruluşlar da dahil olmak üzere ilgili tüm paydaşlarla çalışmayı içerir.

Sektör, etik uzmanları değil, hissedarları göz önünde bulundurarak alınan yapay zeka serbest bırakma kararlarının örnekleriyle doludur. Örneğin, Microsoft’un Bing’deki yapay zeka destekli sohbet robotu olan Bing Chat’i (şimdi Microsoft Copilot) ele alalım. öğle yemeği bir gazeteciyi Hitler’e benzetti ve görünüşlerine hakaret etti. Ekim ayı itibarıyla ChatGPT ve Google’ın ChatGPT rakibi Bard hâlâ vermek modası geçmiş, ırkçı tıbbi tavsiyeler. Ve OpenAI’nin görüntü oluşturucusu DALL-E’nin en son sürümü gösteriliyor kanıt İngilizmerkezcilik.

Yapay zeka üstünlüğü (ya da en azından Wall Street’in yapay zeka üstünlüğü kavramı) uğruna zararlar verildiğini söylemek yeterli. Belki de AB’nin belirli yapay zeka korkuluklarına uyulmamasını cezalandıran yapay zeka düzenlemelerinin kabul edilmesiyle birlikte ufukta biraz umut var. Ama önümüzdeki yol gerçekten uzun.

İşte son birkaç güne ait diğer AI hikayeleri:

2024’te yapay zekaya ilişkin tahminler: Devin, diğer konuların yanı sıra yapay zekanın ABD ön seçimlerini nasıl etkileyebileceğine ve OpenAI için sırada ne olacağına değinerek 2024 yılında yapay zekaya ilişkin tahminlerini ortaya koyuyor.

Psödantropiye karşı: Devin ayrıca yapay zekanın insan davranışını taklit etmesinin yasaklanmasını öneren bir yazı yazdı.

Microsoft Copilot müzik oluşturma olanağına kavuşuyor: Microsoft’un yapay zeka destekli sohbet robotu Copilot, GenAI müzik uygulaması Suno ile entegrasyonu sayesinde artık şarkı besteleyebiliyor.

Rite Aid’de yüz tanıma özelliği kullanıma sunuldu: Federal Ticaret Komisyonu’nun, ABD’li eczane devinin “yüz izleme sistemlerini dikkatsizce kullanmasının” müşterileri küçük düşürdüğünü ve “hassas bilgilerini riske attığını” tespit etmesinden sonra, Rite Aid’in yüz tanıma teknolojisini kullanması beş yıl süreyle yasaklandı.

AB bilgi işlem kaynakları sunmaktadır: AB, ilk olarak Eylül ayında duyurulan ve geçen ay başlatılan planını, bloğun süper bilgisayarlarında model eğitimi için işlem gücüne erişim sağlayarak yerel AI girişimlerini desteklemek için genişletiyor.

OpenAI yönetim kuruluna yeni yetkiler veriyor: OpenAI, zararlı yapay zeka tehdidini savuşturmak için iç güvenlik süreçlerini genişletiyor. Yeni bir “güvenlik danışma grubu” teknik ekiplerin üzerinde yer alacak ve liderliğe tavsiyelerde bulunacak ve yönetim kuruluna veto yetkisi verilecek.

UC Berkeley’den Ken Goldberg ile Soru-Cevap: Brian, düzenli Actuator haber bülteni için, insansı robotlar ve robotik endüstrisindeki daha geniş trendler hakkında konuşmak üzere UC Berkeley’de profesör, startup kurucusu ve başarılı bir robot bilimci olan Ken Goldberg ile bir araya geldi.

CIO’lar gen yapay zekayla işi yavaşlatıyor: Ron, CIO’ların, insanların çevrimiçi ChatGPT ile oynarken gördükleri türden deneyimleri sunma konusunda baskı altındayken çoğunun, teknolojiyi kurumlar için benimseme konusunda bilinçli ve temkinli bir yaklaşım benimsediğini yazıyor.

Haber yayıncıları yapay zeka nedeniyle Google’a dava açıyor: Birkaç haber yayıncısı tarafından açılan toplu davada Google, “sifon çekmekle” suçlanıyor[ing] kısmen Google’ın Arama Üretken Deneyimi (SGE) ve Bard sohbet robotu gibi yapay zeka teknolojileri aracılığıyla, rekabete aykırı yöntemlerle haber içeriğinin kapatılması.

OpenAI mürekkepleri Axel Springer ile ilgileniyor: Yayıncılardan bahsetmişken OpenAI, aralarında Business Insider ve Politico’nun da bulunduğu yayınların Berlin merkezli sahibi Axel Springer ile üretken yapay zeka modellerini yayıncının içeriği üzerinde eğitmek ve Axel Springer tarafından yayınlanan son makaleleri ChatGPT’ye eklemek için bir anlaşma imzaladı.

Google Gemini’yi daha fazla yere getiriyor: Google, Gemini modellerini, Vertex AI tarafından yönetilen AI geliştirme platformu ve şirketin AI tabanlı sohbet robotları ve bu doğrultuda diğer deneyimleri yazmaya yönelik aracı olan AI Studio dahil olmak üzere daha fazla ürün ve hizmetle entegre etti.

Daha fazla makine öğrenimi

Kesinlikle geçen bir veya iki haftanın en çılgın (ve yanlış yorumlanması en kolay) araştırması, hayat2vec, kişinin nasıl biri olduğunu ve ne zaman öleceğini tahmin etmek için kişinin hayatındaki sayısız veri noktasını kullanan Danimarka’da yapılan bir çalışma. Kabaca!

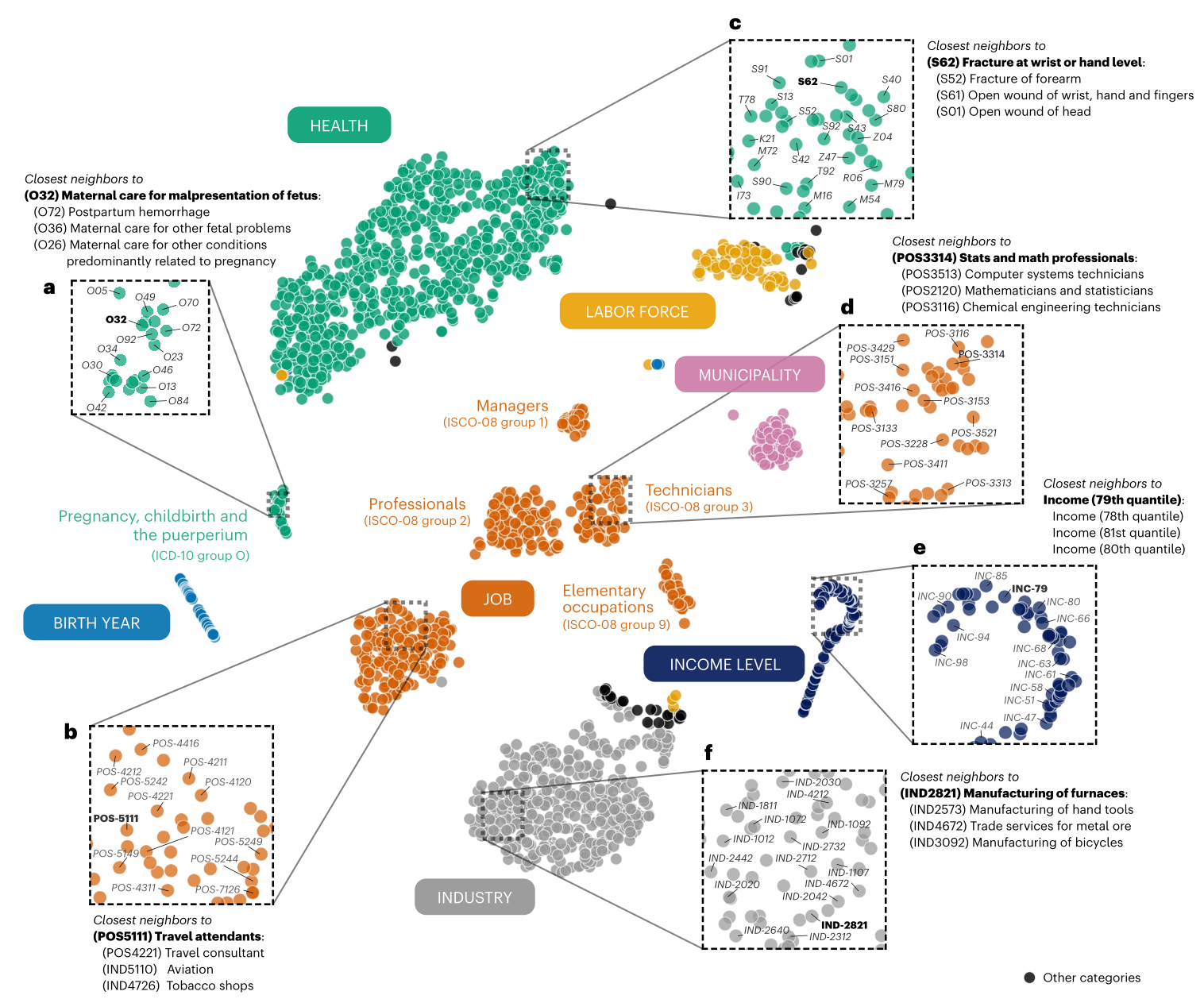

Life2vec’in çeşitli ilgili yaşam kavramları ve olaylarını haritalandırmasının görselleştirilmesi.

Çalışma kehanet doğruluğunu iddia etmiyor (bu arada diyelim ki üç kat hızlı) ama daha ziyade, eğer hayatlarımız deneyimlerimizin toplamıysa, bu yolların mevcut makine öğrenimi teknikleri kullanılarak bir şekilde tahmin edilebileceğini göstermeyi amaçlıyor. Yetiştirilme tarzı, eğitim, iş, sağlık, hobiler ve diğer ölçümler arasında, bir kişinin yalnızca örneğin içe dönük veya dışa dönük olup olmadığı değil, aynı zamanda bu faktörlerin yaşam beklentisini nasıl etkileyebileceği de makul bir şekilde tahmin edilebilir. Burada tam olarak “suç öncesi” seviyelerde değiliz ancak sigorta şirketlerinin bu işe lisans vermek için sabırsızlanacağına bahse girebilirsiniz.

Bir başka büyük iddia da, araştırmacılar için yüksek lisans tabanlı bir asistan olan ve pek çok laboratuvar angaryasını bağımsız olarak yapabilen Coscientist adlı bir sistem yaratan CMU bilim insanları tarafından ortaya atıldı. Şu anda kimyanın belirli alanlarıyla sınırlıdır, ancak tıpkı bilim adamları gibi, bunun gibi modeller de uzman olacaktır.

Baş araştırmacı Gabe Gomes Nature’a söyledi: “Organik olmayan bir zekanın, insanlar tarafından icat edilen bir kimyasal reaksiyonu özerk bir şekilde planlayabildiğini, tasarlayabildiğini ve yürütebildiğini gördüğüm an, bu muhteşemdi. Bu ‘kutsal bir saçmalık’ anıydı. Temel olarak, ortak reaksiyonları, reaktifleri ve prosedürleri tanımlamak ve bunları gerçekleştirmek için kimya belgelerinde ince ayar yapılmış GPT-4 gibi bir LLM kullanır. Yani bir laboratuvar teknisyenine 4 parti katalizör sentezlemesini söylemenize gerek yok; yapay zeka bunu yapabilir ve sizin onun elini tutmanıza bile gerek yok.

Google’ın yapay zeka araştırmacıları da birkaç ilginç sınır alanına dalarak önemli bir hafta geçirdi. Eğlenceli Arama Kulağa çocuklar için Google gibi gelebilir, ancak aslında Coscientist gibi matematiksel keşifler yapabilen ve yapılmasına yardımcı olan işlev aramanın kısaltmasıdır. İlginçtir ki, halüsinasyonları önlemek için bu sistem (son zamanlarda yapılanlar gibi) “eski” GAN mimarisine çok benzer şekilde eşleşen bir çift yapay zeka modeli kullanıyor. Biri teorileştiriyor, diğeri değerlendiriyor.

FunSearch çığır açıcı yeni keşifler yapmayacak olsa da, orada olanı alıp geliştirebilir veya yeni yerlerde yeniden uygulayabilir; böylece bir alanın kullandığı ancak diğerinin farkında olmadığı bir işlev, bir endüstri standardını geliştirmek için kullanılabilir. algoritma.

StilDüşümü üretken görüntüler yoluyla belirli stilleri kopyalamak isteyen kişiler için kullanışlı bir araçtır. Sorun şu ki (araştırmacının da gördüğü gibi) aklınızda bir stil varsa (“pastel” deyin) ve onu tanımlarsanız, modelde yararlanabileceğiniz çok fazla “pastel” alt stili olacak ve bu nedenle sonuçlar şu şekilde olacaktır: öngörülemeyen. StyleDrop, düşündüğünüz stilin bir örneğini sunmanıza olanak tanır ve model, çalışmasını buna dayandıracaktır; bu, temelde süper verimli ince ayardır.

Resim Kredisi: Google

Blog yazısı ve makale, ister fotoğraf, resim, şehir manzarası veya kedi portresi olsun, herhangi bir görüntüden başka herhangi bir görüntü türüne, hatta alfabeye (bazı nedenlerden dolayı oldukça zor) bir stil uygulamanın oldukça sağlam olduğunu gösteriyor.

Google aynı zamanda bir dizi video görevini yerine getirmek, metni veya görüntüleri videoya dönüştürmek, videoya dönüştürmek ve videonun içeriğini genişletmek için bir Yüksek Lisans tabanı (bugünlerde her şey gibi… başka ne kullanacaksınız?) kullanan VideoPoet ile üretken video oyununa da devam ediyor. veya mevcut videonun stilize edilmesi vb. Buradaki zorluk, her projenin açıkça ortaya koyduğu gibi, yalnızca birbiriyle ilişkili bir dizi görüntü oluşturmak değil, aynı zamanda onları daha uzun süreler boyunca (örneğin bir saniyeden fazla) ve büyük hareketler ve değişikliklerle tutarlı hale getirmektir.

Resim Kredisi: Google

VideoŞair topu ileri doğru hareket ettiriyor, öyle görünüyor ki, görebileceğiniz gibi sonuçlar hala oldukça tuhaf. Ama işler böyle yürüyor: Önce yetersizler, sonra tuhaflar, sonra tekinsizler. Muhtemelen bir noktada esrarengizliği bırakıyorlar ama henüz kimse oraya ulaşamadı.

İşin pratik tarafında İsviçreli araştırmacılar yapay zeka modellerini kar ölçümüne uyguluyor. Normalde hava durumu istasyonlarına güveniriz, ancak bunlar çok uzakta olabilir ve elimizde çok güzel uydu verileri var, değil mi? Sağ. ETHZ ekibi Sentinel-2 takımyıldızından halka açık uydu görüntüleri aldı ancak lider Konrad Schindler’in belirttiği gibi, “Uydu görüntülerindeki beyaz parçalara bakmak bize karın ne kadar derin olduğunu hemen söylemez.”

Böylece Federal Topografya Ofisi’nden (USGS gibi) tüm ülke için arazi verilerini koydular ve sistemi yalnızca görüntülerdeki beyaz parçalara değil, aynı zamanda temel gerçek verilerine ve erime modelleri gibi eğilimlere dayalı olarak tahmin yapacak şekilde eğittiler. Ortaya çıkan teknoloji, daha fazlasını öğrenmek için iletişime geçmek üzere olduğum ExoLabs tarafından ticarileştiriliyor.

Stanford’dan uyarıBununla birlikte, yukarıdaki gibi uygulamalar ne kadar güçlü olsa da, bunların hiçbirinin insan önyargısı açısından pek bir şey içermediğini unutmayın. Sağlık söz konusu olduğunda, bu aniden büyük bir sorun haline geliyor ve sağlık, tonlarca yapay zeka aracının test edildiği alan. Stanford araştırmacıları yapay zeka modellerinin “eski tıbbi ırksal kinayeleri” yaydığını gösterdi. GPT-4 bir şeyin doğru olup olmadığını bilmez, dolayısıyla siyahi insanların akciğer kapasitesinin daha düşük olduğu gibi gruplar hakkındaki eski, çürütülmüş iddiaları tekrarlayabilir ve tekrarlıyor. Hayır! Sağlık ve tıp alanında herhangi bir yapay zeka modeliyle çalışıyorsanız tetikte olun.

Son olarak, Bard tarafından yazılan, çekim senaryosu ve yönlendirmelerle birlikte VideoPoet tarafından oluşturulan bir kısa öyküyü burada bulabilirsiniz. Dikkat et Pixar!